Quelle: Pacific Standard (Englisch)

Das Problem mit der Unwissenheit ist, dass sie sich so sehr wie Fachwissen anfühlt. Ein führender Forscher auf dem Gebiet der Psychologie des menschlichen Unrechts bringt uns auf die richtige Spur.

Es folgt ein übersetzter Artikel, geschrieben von David Dunning und veröffentlicht by Pacific Standard:

(PS.: David Dunning ist der im Namen "Dunning-Kruger Effekt", mehr dazu später)

Im vergangenen März, während des riesigen Musikfestivals South by Southwest in Austin, Texas, schickte die Late-Night-Talkshow Jimmy Kimmel Live! ein Kamerateam auf die Straße, um Hipster beim Bluffen zu erwischen. "Leute, die auf Musikfestivals gehen, sind stolz darauf, zu wissen, wer die nächsten Acts sind", sagte Kimmel zu seinem Studiopublikum, "auch wenn sie nicht wissen, wer die neuen Acts sind." Also ließ der Moderator sein Team Festivalbesucher nach ihren Gedanken über Bands fragen, die es gar nicht gibt.

"Das große Gerücht auf der Straße", sagte einer von Kimmels Interviewern zu einem Mann mit einer dickrandigen Brille und einem skurrilen T-Shirt, "ist Contact Dermatitis. Glauben Sie, dass er das Zeug dazu hat, ganz groß rauszukommen?"

"Auf jeden Fall", antwortete der verblüffte Fan.

Der Streich war eine Folge von Kimmels wiederkehrender "Lie Witness News"-Sendung, in der er Passanten verschiedene Fragen mit falschen Voraussetzungen stellt. In einer anderen Folge fragte Kimmels Team Menschen auf dem Hollywood Boulevard, ob sie den Film Godzilla aus dem Jahr 2014 für unsensibel gegenüber den Überlebenden des Angriffs der Riesenechse auf Tokio im Jahr 1954 hielten; in einer dritten Folge fragten sie, ob Bill Clinton genug Anerkennung für die Beendigung des Koreakriegs bekomme und ob sein Auftritt als Juror bei America's Got Talent seinem Erbe schaden würde. "Nein", antwortete eine Frau auf diese letzte Frage. "Es wird ihn noch beliebter machen."

Die Menschen, die in Kimmels Falle tappen, können einem nur leid tun. Einige scheinen bereit zu sein, vor der Kamera so ziemlich alles zu sagen, um ihre Ahnungslosigkeit in Bezug auf das jeweilige Thema zu verbergen (was natürlich den gegenteiligen Effekt hat). Andere scheinen sehr bemüht zu sein, den Interviewer nicht zu enttäuschen, indem sie die langweiligste und passendste Antwort geben: Ich weiß es nicht. Aber bei einigen dieser Befragten kann die Falle noch tiefer liegen. Die selbstbewusstesten Befragten scheinen oft zu glauben, dass sie eine Ahnung haben - als ob es eine Tatsache, eine Erinnerung oder eine Intuition gäbe, die ihnen versichert, dass ihre Antwort angemessen ist.

Auf dem South by Southwest Festival sprach Kimmels Team eine junge Frau mit braunem Haar an. "Was haben Sie über Tonya und die Hardings gehört?", fragte der Interviewer. "Haben Sie gehört, dass sie ziemlich hart im Nehmen sind?" Da die Frau dieses verbale Augenzwinkern nicht aufnahm, begann sie mit einer ausführlichen Antwort über die fiktive Band. "Ja, eine Menge Männer haben über sie gesprochen und gesagt, dass sie wirklich beeindruckt sind", antwortete sie. "Normalerweise sind sie keine Fans von Frauengruppen, aber sie setzen wirklich ein Zeichen." Aus einigen geistigen Spinnweben konnte sie eine maßgebliche Rezension von Tonya and the Hardings spinnen, die bestimmte detaillierte Fakten enthielt: dass sie real sind; dass sie weiblich sind (ganz zu schweigen davon, dass, sagen wir, Marilyn Manson und Alice Cooper es nicht sind); und dass sie eine harte, Grenzen überschreitende Gruppe sind.

In vielen Fällen lässt Inkompetenz die Menschen nicht desorientiert, verwirrt oder vorsichtig werden. Stattdessen sind die Inkompetenten oft mit einem unangemessenen Selbstvertrauen gesegnet, das von etwas getragen wird, das sich für sie wie Wissen anfühlt.

Natürlich müssen sich Kimmels Produzenten die lächerlichsten Interviews für die Ausstrahlung aussuchen. Aber das Late-Night-Fernsehen ist nicht der einzige Ort, an dem man Menschen dabei beobachten kann, wie sie aus dem Stegreif über Themen sprechen, von denen sie keine Ahnung haben. In den feierlicheren Räumlichkeiten eines Forschungslabors an der Cornell University führen die Psychologen Stav Atir, Emily Rosenzweig und ich laufend Untersuchungen durch, die auf eine sorgfältig kontrollierte, weniger extravagante Version von Jimmy Kimmels Auftritt hinauslaufen. In unserer Arbeit fragen wir die Befragten, ob sie mit bestimmten technischen Konzepten aus der Physik, Biologie, Politik und Geografie vertraut sind. Eine ganze Reihe behauptet, mit echten Begriffen wie Zentripetalkraft und Photon vertraut zu sein. Interessanterweise geben sie aber auch an, mit Begriffen vertraut zu sein, die völlig frei erfunden sind, wie Parallaxenplatten, Ultra-Lipid und Cholarine. In einer Studie gaben etwa 90 Prozent der Befragten an, mindestens einen der neun fiktiven Begriffe zu kennen, nach denen wir sie gefragt hatten. Je mehr sich die Befragten in einem allgemeinen Thema für bewandert hielten, desto vertrauter waren sie mit den bedeutungslosen Begriffen, die in der Umfrage mit diesem Thema in Verbindung gebracht wurden.

Es ist schon seltsam, dass Menschen, die sich als politische Experten ausgeben, behaupten, sowohl Susan Rice (die nationale Sicherheitsberaterin von Präsident Barack Obama) als auch Michael Merrington (eine angenehm klingende Silbenfolge) zu kennen. Aber so überraschend ist das nicht. Seit mehr als 20 Jahren untersuche ich das Verständnis der Menschen für ihr eigenes Fachwissen - formell bekannt als Metakognition, d. h. die Prozesse, mit denen Menschen ihr Wissen, ihre Argumentation und ihr Lernen bewerten und regulieren - und die Ergebnisse sind durchweg ernüchternd, gelegentlich komisch und niemals langweilig.

Der amerikanische Autor und Aphoristiker William Feather schrieb einmal, Bildung bedeute, "in der Lage zu sein, zwischen dem, was man weiß, und dem, was man nicht weiß, zu unterscheiden". Wie sich herausstellt, ist dieses einfache Ideal äußerst schwer zu erreichen. Obwohl das, was wir wissen, für uns oft wahrnehmbar ist, sind selbst die groben Umrisse dessen, was wir nicht wissen, allzu oft völlig unsichtbar. Wir sind uns der Häufigkeit und des Umfangs unserer Unwissenheit weitgehend nicht bewusst.

Im Jahr 1999 veröffentlichten mein damaliger Doktorand Justin Kruger und ich im Journal of Personality and Social Psychology einen Artikel, in dem wir dokumentierten, dass inkompetente Menschen in vielen Bereichen des Lebens nicht erkennen - streichen Sie das - wie inkompetent sie sind, ein Phänomen, das als Dunning-Kruger-Effekt bekannt geworden ist. Die Logik selbst verlangt geradezu nach diesem Mangel an Selbsterkenntnis: Um ihre Unzulänglichkeit zu erkennen, müssten schlechte Leistungsträger genau das Fachwissen besitzen, das ihnen fehlt. Um zu wissen, wie geschickt oder ungeschickt man die Regeln der Grammatik anwendet, muss man beispielsweise über gute Kenntnisse dieser Regeln verfügen - ein Ding der Unmöglichkeit für die Unfähigen. Schlechte Leistungsträger - und wir alle sind in manchen Dingen schlechte Leistungsträger - erkennen nicht die Fehler in ihrem Denken oder die Antworten, die ihnen fehlen.

Merkwürdig ist, dass Inkompetenz in vielen Fällen nicht dazu führt, dass Menschen desorientiert, verwirrt oder vorsichtig werden. Stattdessen sind die Inkompetenten oft mit einem unangemessenen Selbstvertrauen gesegnet, das von etwas getragen wird, das sich für sie wie Wissen anfühlt.

Dies ist nicht nur eine Theorie aus dem Sessel. Eine ganze Reihe von Studien, die von mir und anderen durchgeführt wurden, haben bestätigt, dass Menschen, die nicht viel über bestimmte kognitive, technische oder soziale Fähigkeiten wissen, dazu neigen, ihr Können und ihre Leistung stark zu überschätzen, ganz gleich, ob es sich um Grammatik, emotionale Intelligenz, logisches Denken, Pflege und Sicherheit von Schusswaffen, Debattieren oder Finanzwissen handelt. College-Studenten, die Klausuren einreichen, die ihnen Ds und Fs einbringen, neigen dazu, ihre Bemühungen für weitaus bessere Noten zu halten; leistungsschwache Schachspieler, Bridgespieler und Medizinstudenten sowie ältere Menschen, die einen neuen Führerschein beantragen, überschätzen ihre Kompetenz ebenfalls bei weitem.

Gelegentlich kann man diese Tendenz sogar in den großen Bewegungen der Geschichte beobachten. Die Finanzkrise von 2008 wurde unter anderem durch den Zusammenbruch einer epischen Immobilienblase ausgelöst, die durch die Machenschaften von Finanziers und die Unwissenheit der Verbraucher angeheizt wurde. Jüngste Untersuchungen deuten darauf hin, dass die finanzielle Unwissenheit vieler Amerikaner von der unangemessen zuversichtlichen Sorte ist. Im Jahr 2012 wurden im Rahmen der National Financial Capability Study, die von der Regulierungsbehörde für die Finanzindustrie (in Zusammenarbeit mit dem US-Finanzministerium) durchgeführt wurde, rund 25 000 Befragte gebeten, ihr eigenes Finanzwissen einzuschätzen, und anschließend wurde ihr tatsächliches Finanzwissen gemessen.

Die rund 800 Befragten, die angaben, in den letzten zwei Jahren Konkurs angemeldet zu haben, schnitten bei dem Test ziemlich schlecht ab - im Durchschnitt auf dem 37. Aber sie bewerteten ihr Finanzwissen insgesamt nicht weniger, sondern mehr positiv als die anderen Befragten. Der Unterschied war gering, aber er war über jeden statistischen Zweifel erhaben: 23 Prozent der kürzlich in Konkurs gegangenen Befragten gaben sich selbst die höchstmögliche Selbsteinschätzung; von den übrigen Befragten taten dies nur 13 Prozent. Warum das Selbstvertrauen? Wie die Opfer von Jimmy Kimmel reagierten auch die Befragten, die in Konkurs gegangen sind, besonders allergisch darauf, "Ich weiß es nicht" zu sagen. Wenn sie sich bei einer Frage irrten, war die Wahrscheinlichkeit, dass sie eine Unwahrheit sagten, um 67 Prozent höher als bei ihren Altersgenossen. Mit einem Kopf voller "Wissen" schätzten sie ihr Finanzwissen also als sehr gut ein.

Da es so einfach ist, die Idiotie anderer zu beurteilen, ist es vielleicht verlockend zu denken, dass dies nicht auf einen selbst zutrifft. Aber das Problem der unerkannten Unwissenheit ist eines, das uns alle betrifft. Und im Laufe der Jahre bin ich zu der Überzeugung gelangt, dass es eine wichtige, übergreifende Tatsache über den unwissenden Geist gibt. Man sollte ihn nicht als uninformiert betrachten. Vielmehr sollte man ihn als _mis_informiert betrachten.

Ein unwissendes Gehirn ist eben kein makelloses, leeres Gefäß, sondern eines, das mit irrelevanten oder irreführenden Lebenserfahrungen, Theorien, Fakten, Intuitionen, Strategien, Algorithmen, Heuristiken, Metaphern und Ahnungen gefüllt ist, die bedauerlicherweise das Aussehen und die Anmutung von nützlichem und korrektem Wissen haben. Dieses Durcheinander ist ein unglückliches Nebenprodukt einer unserer größten Stärken als Spezies. Wir sind ungezügelte Mustererkenner und ausschweifende Theoretiker. Oft sind unsere Theorien gut genug, um uns durch den Tag zu bringen, oder zumindest bis zu einem Alter, in dem wir uns fortpflanzen können. Aber unser Genie für kreatives Geschichtenerzählen in Verbindung mit unserer Unfähigkeit, unsere eigene Unwissenheit zu erkennen, kann manchmal zu Situationen führen, die peinlich, unglücklich oder geradezu gefährlich sind - vor allem in einer technologisch fortgeschrittenen, komplexen demokratischen Gesellschaft, die gelegentlich falschen Volksglauben mit immenser zerstörerischer Kraft ausstattet (siehe: Finanzkrise; Krieg, Irak). Der Humorist Josh Billings hat es einmal so ausgedrückt: "Es ist nicht das, was man nicht weiß, das einen in Schwierigkeiten bringt. Es ist das, was du mit Sicherheit weißt, was nicht stimmt." (Ironischerweise "wissen" viele Menschen über dieses Zitat, dass es zuerst von Mark Twain oder Will Rogers geäußert wurde - was einfach nicht stimmt).

Aufgrund unseres Aufbaus und der Art und Weise, wie wir von unserer Umwelt lernen, sind wir alle Motoren des Irrglaubens. Und je besser wir verstehen, wie unsere wunderbare, wenn auch schwerfällige Rube-Goldberg-Maschine funktioniert, desto besser können wir - als Individuen und als Gesellschaft - sie nutzen, um zu einem objektiveren Verständnis der Wahrheit zu gelangen.

FALSCH GEBOREN

Einige unserer tiefsten Intuitionen über die Welt reichen bis in unsere Wiege zurück. Noch vor ihrem zweiten Geburtstag wissen Babys, dass zwei feste Objekte nicht im selben Raum existieren können. Sie wissen, dass Gegenstände weiter existieren, wenn sie außer Sichtweite sind, und dass sie fallen, wenn sie nicht gestützt werden. Sie wissen, dass Menschen aufstehen und sich als autonome Wesen fortbewegen können, der Computer auf dem Schreibtisch jedoch nicht. Aber nicht alle unsere frühesten Intuitionen sind so solide.

Sehr kleine Kinder haben auch einen Irrglauben, den sie bis zu einem gewissen Grad für den Rest ihres Lebens beibehalten werden. Ihr Denken ist zum Beispiel durch eine starke Tendenz gekennzeichnet, Organismen fälschlicherweise Absichten, Funktionen und Zwecke zuzuschreiben. Für ein Kind ist der wichtigste biologische Aspekt eines Lebewesens die Rolle, die es im Reich des Lebens spielt. Auf die Frage, warum es Tiger gibt, werden Kinder betonen, dass sie "für den Zoo gemacht sind". Auf die Frage, warum Bäume Sauerstoff produzieren, antworten die Kinder, dass sie dies tun, damit die Tiere atmen können.

Jeder konventionelle Biologie- oder Naturwissenschaftsunterricht wird versuchen, diese Neigung zu zweckorientiertem Denken einzudämmen. Aber sie verlässt uns nie wirklich. Erwachsene mit wenig formaler Bildung zeigen eine ähnliche Voreingenommenheit. Und wenn man sie drängt, machen sogar professionelle Wissenschaftler zweckgerichtete Fehler. Die Psychologin Deborah Kelemen von der Boston University und einige Kollegen haben dies in einer Studie nachgewiesen, in der 80 Wissenschaftler - Menschen mit Universitätsberufen in den Bereichen Geowissenschaften, Chemie und Physik - gebeten wurden, 100 verschiedene Aussagen darüber, "warum Dinge in der natürlichen Welt geschehen", als wahr oder falsch zu bewerten. Unter den Erklärungen befanden sich auch falsche, zweckgebundene Erklärungen wie "Moos bildet sich um Felsen, um die Bodenerosion zu stoppen" und "Die Erde hat eine Ozonschicht, um sie vor UV-Licht zu schützen". Die Studienteilnehmer durften die Aufgabe entweder in ihrem eigenen Tempo bearbeiten oder sie hatten nur 3,2 Sekunden Zeit, um auf jedes Element zu antworten. Wenn die Wissenschaftler sich beeilten, verdoppelten sie ihre Zustimmung zu falschen zweckgerichteten Erklärungen, von 15 auf 29 Prozent.

Diese zweckgerichtete Fehleinschätzung wirkt sich besonders nachteilig auf den Versuch aus, eines der wichtigsten Konzepte der modernen Wissenschaft zu vermitteln: die Evolutionstheorie. Selbst Laien, die die Theorie befürworten, glauben oft eine falsche Version davon. Sie schreiben der Evolution ein Maß an Handlungsfähigkeit und Organisation zu, das es einfach nicht gibt. Fragt man viele Laien, warum z. B. Geparden so schnell rennen können, werden sie erklären, dass dies darauf zurückzuführen ist, dass die Katzen - fast als Gruppe - vermuteten, dass sie mehr Beute fangen könnten, wenn sie nur schneller rennen könnten, und so erwarben sie diese Eigenschaft und gaben sie an ihre Jungen weiter. Nach dieser Auffassung ist die Evolution im Wesentlichen ein Strategiespiel auf Artniveau.

Diese Vorstellung von Evolution lässt die wesentliche Rolle außer Acht, die individuelle Unterschiede und der Wettbewerb zwischen den Mitgliedern einer Art als Reaktion auf Umweltbelastungen spielen: Einzelne Geparden, die schneller laufen können, fangen mehr Beute, leben länger und pflanzen sich erfolgreicher fort; langsamere Geparden verlieren und sterben aus - und die Art driftet dahin, insgesamt schneller zu werden. Die Evolution ist das Ergebnis von zufälligen Unterschieden und natürlicher Auslese, nicht von Einfluss oder Wahl.

Aber der Glaube an das Modell der Evolution mit "Einfluss" ist schwer zu widerlegen. Die Aufklärung über die Evolution kann zwar dazu führen, dass Menschen nicht mehr uninformiert, sondern gut informiert sind, aber in einigen hartnäckigen Fällen führt sie auch dazu, dass sie mit Sicherheit falsch informiert sind. Im Jahr 2014 veröffentlichten Tony Yates und Edmund Marek eine Studie, in der die Auswirkungen des Biologieunterrichts an der High School von Oklahoma auf das Verständnis der Evolutionstheorie von 536 Schülern untersucht wurden. Die Schüler wurden vor dem Biologie-Einführungskurs und kurz danach erneut zu ihrem Wissen über die Evolution befragt. Es überrascht nicht, dass das Vertrauen der Schüler in ihr Wissen über die Evolutionstheorie nach dem Unterricht in die Höhe schoss, und sie stimmten einer größeren Anzahl von zutreffenden Aussagen zu. So weit, so gut.

Das Problem ist nur, dass auch die Anzahl der falschen Vorstellungen, die die Gruppe bestätigte, in die Höhe schoss. So stieg beispielsweise der Prozentsatz der Schüler, die der wahren Aussage "Die Evolution kann nicht bewirken, dass sich die Eigenschaften eines Organismus im Laufe seines Lebens verändern" voll und ganz zustimmten, von 17 auf 20 Prozent - aber auch der Prozentsatz derer, die ihr nicht voll und ganz zustimmten, stieg von 16 auf 19 Prozent. Bei der ebenfalls zutreffenden Aussage "Variation zwischen Individuen ist wichtig, damit Evolution stattfinden kann" führte die Unterweisung zu einem Anstieg der starken Zustimmung von 11 auf 22 Prozent, aber auch die starke Ablehnung stieg von neun auf 12 Prozent. Bezeichnenderweise war die einzige Antwort, die nach der Belehrung einheitlich zurückging, "Ich weiß es nicht".

Und es ist nicht nur die Evolution, die den Schülern zu schaffen macht. Die Forschung hat immer wieder festgestellt, dass herkömmliche Erziehungspraktiken weitgehend versagen, wenn es darum geht, eine Reihe von Irrglauben auszurotten, die uns in die Wiege gelegt wurden. Die Bildung schafft es nicht, Menschen zu korrigieren, die glauben, dass das Sehen nur möglich ist, weil das Auge Energie oder eine Substanz an die Umgebung abgibt. Es gelingt ihr nicht, gängige Annahmen über die Flugbahn fallender Gegenstände zu korrigieren. Und es gelingt ihr nicht, die Schüler von der Vorstellung zu befreien, dass Licht und Wärme nach denselben Gesetzen wie materielle Stoffe wirken. Was Bildung jedoch oft zu tun scheint, ist, uns Vertrauen in die Fehler zu geben, die wir beibehalten.

FALSCH ANGEWANDTE REGELN

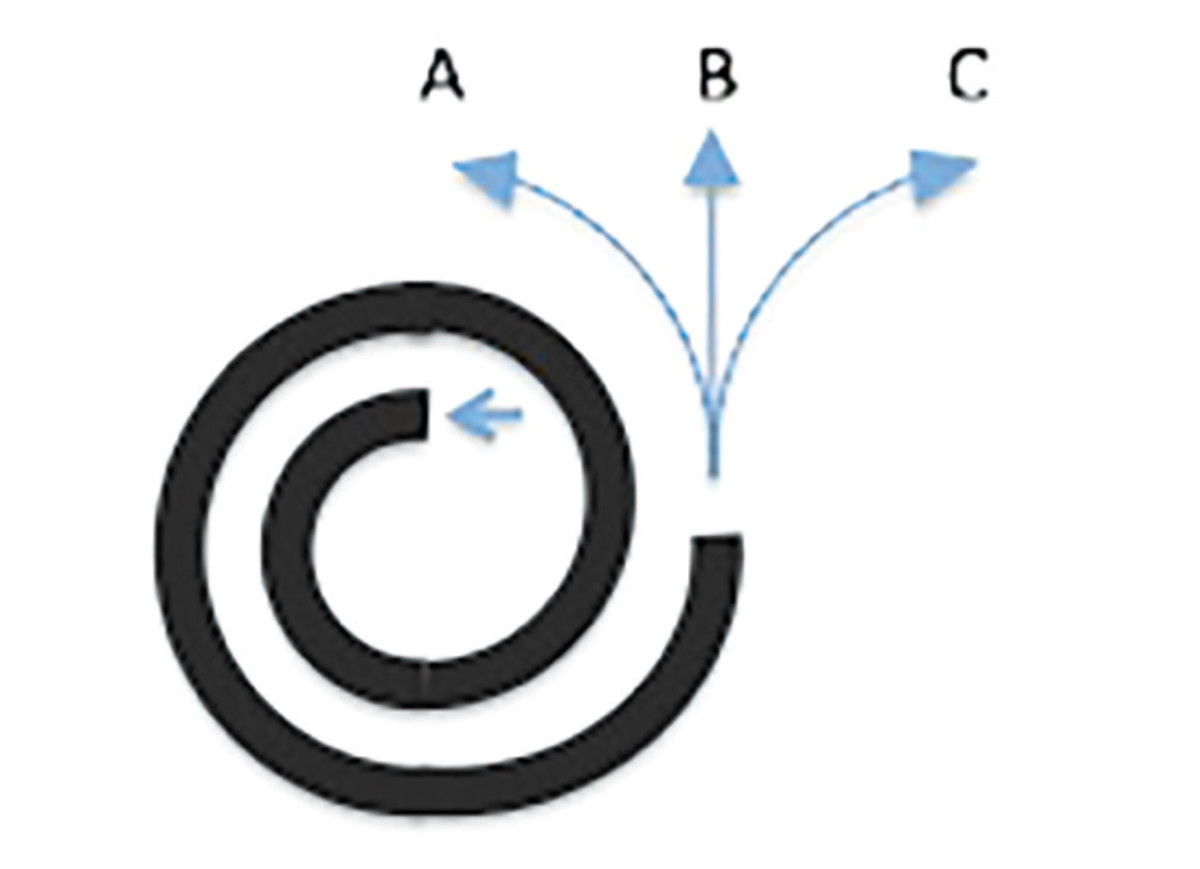

Stellen Sie sich vor, dass die folgende Abbildung eine gebogene Röhre darstellt, die waagerecht auf einem Tisch liegt:

In einer Studie zur intuitiven Physik im Jahr 2013 präsentierten Elanor Williams, Justin Kruger und ich den Teilnehmern mehrere Variationen dieses Bildes eines gekrümmten Rohrs und baten sie, die Flugbahn eines Balls (in der Abbildung mit A, B oder C markiert) zu bestimmen, nachdem er durch die einzelnen Varianten geflogen war. Einige Personen erzielten perfekte Ergebnisse und schienen es zu wissen, denn sie waren sich ihrer Antworten ziemlich sicher. Andere schnitten etwas weniger gut ab - und auch sie schienen es zu wissen, denn ihre Zuversicht war deutlich gedämpfter.

Aber etwas Merkwürdiges geschah, als wir uns die Leute ansahen, die bei unserem kleinen Quiz extrem schlecht abgeschnitten hatten. Jetzt können Sie es vielleicht schon erahnen: Diese Personen äußerten mehr, nicht weniger, Vertrauen in ihre Leistung. Tatsächlich äußerten die Personen, die keine der Aufgaben richtig gelöst hatten, oft ein ähnliches Selbstvertrauen wie die Spitzenkräfte. In der Tat war diese Studie das dramatischste Beispiel für den Dunning-Kruger-Effekt, das wir je gesehen haben: Wenn man nur das Selbstvertrauen der Personen betrachtet, die 100 Prozent richtig und null Prozent richtig hatten, war es oft unmöglich zu sagen, wer zu welcher Gruppe gehörte.

Warum? Weil beide Gruppen "etwas wussten". Sie wussten, dass es eine strenge, konsistente Regel gab, die man befolgen musste, um die Flugbahn der Kugeln vorherzusagen. Die eine Gruppe kannte das richtige Newtonsche Prinzip: dass die Kugel in dem Moment, in dem sie die Röhre verlässt, in die Richtung weiterfliegt, in die sie gegangen ist - Weg B. Befreit von den Zwängen der Röhre, würde sie einfach geradeaus fliegen.

Diejenigen, die alle Fragen falsch beantworteten, antworteten in der Regel, dass die Kugel den Weg A nehmen würde. Im Wesentlichen lautete ihre Regel, dass die Röhre der Kugel einen gekrümmten Impuls geben würde, dem sie beim Verlassen der Röhre weiter folgen würde. Diese Antwort ist nachweislich falsch, wird aber von einer Vielzahl von Menschen befürwortet.

Diese Menschen befinden sich in guter Gesellschaft. Im Jahr 1500 n. Chr. wäre Weg A die akzeptierte Antwort unter den an der Physik interessierten Gelehrten gewesen. Sowohl Leonardo da Vinci als auch der französische Philosoph Jean Buridan befürworteten ihn. Und er ergibt auch einen gewissen Sinn. Eine Theorie des gekrümmten Antriebs würde gängige, alltägliche Rätsel erklären, z. B. warum sich Räder auch dann noch drehen, wenn jemand aufhört, den Wagen zu schieben, oder warum die Planeten weiterhin ihre engen und regelmäßigen Bahnen um die Sonne ziehen. Wenn diese Probleme "erklärt" sind, ist es ein einfacher Schritt, diese Erklärung auf andere Probleme zu übertragen, z. B. auf solche, die mit Röhren zu tun haben.

Was diese Studie veranschaulicht, ist eine weitere allgemeine Art und Weise - zusätzlich zu den Fehlern, die uns in die Wiege gelegt wurden -, auf die Menschen häufig einen Irrglauben erzeugen: Wir importieren Wissen aus einem geeigneten Umfeld in ein Umfeld, in dem es unangebracht ist.

Hier ist ein weiteres Beispiel: Laut Pauline Kim, einer Professorin an der Washington University Law School, neigen Menschen dazu, aus dem, was sie über informellere soziale Normen wissen, Rückschlüsse auf das Gesetz zu ziehen. Dies führt häufig dazu, dass sie ihre Rechte missverstehen - und in Bereichen wie dem Arbeitsrecht sogar stark überschätzen. Im Jahr 1997 präsentierte Kim etwa 300 Einwohnern von Buffalo, New York, eine Reihe moralisch abscheulicher Szenarien am Arbeitsplatz - zum Beispiel wird ein Angestellter gefeuert, weil er einen Mitarbeiter des Unternehmens des Diebstahls bezichtigt -, die jedoch nach dem "at-will"-Arbeitsrecht des Staates legal waren. Achtzig bis 90 Prozent der Bürger von Buffalo bezeichneten jedes dieser geschmacklosen Szenarien fälschlicherweise als illegal, was zeigt, wie wenig sie darüber wissen, wie viel Freiheit Arbeitgeber bei der Entlassung von Mitarbeitern tatsächlich haben. (Warum ist das wichtig? Rechtsgelehrte haben lange Zeit die "at-will"-Beschäftigungsregeln mit der Begründung verteidigt, dass die Arbeitnehmer ihnen in Scharen zustimmen, ohne sich um bessere Arbeitsbedingungen zu bemühen. Kim hat gezeigt, dass die Arbeitnehmer nur selten verstehen, wozu sie ihre Zustimmung geben.)

Auch Ärzte sind mit dem Problem der unangemessenen Weitergabe von Wissen im Umgang mit Patienten vertraut. Oft ist es nicht die Krankheit selbst, die ein Arzt besiegen muss, sondern die falschen Vorstellungen des Patienten, die sie schützen. Ältere Patienten weigern sich beispielsweise häufig, den Rat ihres Arztes zu befolgen, Sport zu treiben, um ihre Schmerzen zu lindern - eine der wirksamsten Strategien überhaupt -, weil sie den körperlichen Schmerz und das Unbehagen, das sie beim Sport empfinden, mit Verletzungen und Verschlechterung in Verbindung bringen. Untersuchungen des Verhaltensökonomen Sendhil Mullainathan haben ergeben, dass Mütter in Indien ihren an Durchfall erkrankten Kindern oft das Wasser vorenthalten, weil sie ihre Kinder fälschlicherweise als undichte Eimer betrachten - und nicht als zunehmend dehydrierte Wesen, die dringend Wasser benötigen.

MOTIVIERTE ARGUMENTATION

Einige unserer hartnäckigsten Irrglauben entspringen nicht primitiven kindlichen Intuitionen oder unvorsichtigen Kategorienfehlern, sondern den Werten und Philosophien, die uns als Individuen definieren, wer wir sind. Jeder von uns besitzt bestimmte grundlegende Überzeugungen - Erzählungen über sich selbst, Vorstellungen über die soziale Ordnung -, die im Grunde nicht verletzt werden können: Ihnen zu widersprechen, würde unseren Selbstwert in Frage stellen. Als solche verlangen diese Ansichten Loyalität von anderen Meinungen. Und jede Information, die wir aus der Welt erfahren, wird abgeändert, verzerrt, abgeschwächt oder vergessen, um sicherzustellen, dass diese unantastbaren Überzeugungen ganz und unversehrt bleiben.

Die Art und Weise, wie wir uns traditionell Unwissenheit vorstellen - als Abwesenheit von Wissen - verleitet uns dazu, Bildung als ihr natürliches Gegenmittel zu betrachten. Aber Bildung kann illusorisches Vertrauen erzeugen.

Ein sehr weit verbreiteter, unantastbarer Glaube geht zum Beispiel in etwa so: Ich bin ein fähiger, guter und fürsorglicher Mensch. Jede Information, die dieser Prämisse widerspricht, kann auf ernsthaften mentalen Widerstand stoßen. Auch politische und ideologische Überzeugungen gehen oft in den Bereich des Unantastbaren über. Die anthropologische Theorie der kulturellen Kognition legt nahe, dass die Menschen überall dazu neigen, sich ideologisch in kulturelle Weltanschauungen einzuteilen, die entlang einiger Achsen divergieren: Entweder sind sie individualistisch (sie bevorzugen Autonomie, Freiheit und Eigenständigkeit) oder kommunitär (sie messen den Vorteilen und Kosten, die von der gesamten Gemeinschaft getragen werden, mehr Gewicht bei); und sie sind entweder hierarchisch (sie bevorzugen die Verteilung sozialer Pflichten und Ressourcen entlang einer festen Rangordnung) oder egalitär (sie lehnen die Idee einer Rangordnung nach Status ab). Nach der Theorie der kulturellen Kognition verarbeiten Menschen Informationen in einer Weise, die diese Organisationsprinzipien nicht nur widerspiegelt, sondern sie auch verstärkt. Diese ideologischen Ankerpunkte können einen tiefgreifenden und weitreichenden Einfluss darauf haben, was die Menschen glauben, und sogar darauf, was sie als wahr "wissen".

Es ist vielleicht nicht so überraschend zu hören, dass Fakten, Logik und Wissen so zurechtgebogen werden können, dass sie mit der subjektiven Weltsicht einer Person übereinstimmen; schließlich werfen wir unseren politischen Gegnern diese Art von "motivierter Argumentation" ständig vor. Aber das Ausmaß dieser Beugung kann bemerkenswert sein. In Zusammenarbeit mit dem Politikwissenschaftler Peter Enns hat mein Labor herausgefunden, dass die politische Einstellung einer Person andere logische oder faktische Überzeugungen so stark verzerren kann, dass sie in direkten Widerspruch zueinander geraten. In einer Ende 2010 durchgeführten Umfrage unter rund 500 Amerikanern fanden wir heraus, dass mehr als ein Viertel der Liberalen (aber nur sechs Prozent der Konservativen) sowohl die Aussage "Die Politik von Präsident Obama hat bereits zu einem starken Aufschwung der Wirtschaft geführt" als auch "Gesetze und Vorschriften, die von der vorherigen republikanischen Präsidentschaftsregierung erlassen wurden, haben einen starken wirtschaftlichen Aufschwung unmöglich gemacht" befürworteten. Beide Aussagen sind für das liberale Auge angenehm und ehren eine liberale Ideologie, aber wie kann Obama bereits einen starken Aufschwung geschaffen haben, den die Politik der Republikaner unmöglich gemacht hat? Unter den Konservativen stimmten 27 Prozent (im Vergleich zu nur 10 Prozent der Liberalen) sowohl der Aussage zu, dass "Präsident Obamas rhetorische Fähigkeiten elegant sind, aber nicht ausreichen, um wichtige internationale Themen zu beeinflussen", als auch der Aussage, dass "Präsident Obama nicht genug getan hat, um seine rhetorischen Fähigkeiten zu nutzen, um einen Regimewechsel im Irak zu erreichen". Aber wenn Obamas Fähigkeiten unzureichend sind, warum sollte er dann dafür kritisiert werden, dass er sie nicht einsetzt, um die irakische Regierung zu beeinflussen?

Unantastbare ideologische Verpflichtungen können uns auch dazu bringen, schnelle, intensive Meinungen zu Themen zu entwickeln, über die wir so gut wie nichts wissen - Themen, die auf den ersten Blick nichts mit Ideologie zu tun haben. Nehmen wir den aufstrebenden Bereich der Nanotechnologie. Bei der Nanotechnologie handelt es sich grob gesagt um die Herstellung von Produkten auf atomarer oder molekularer Ebene, die in der Medizin, der Energieerzeugung, bei Biomaterialien und in der Elektronik Anwendung finden. Wie so ziemlich jede neue Technologie birgt auch die Nanotechnologie ein großes Nutzenversprechen (antibakterielle Lebensmittelbehälter!) und das Risiko ernsthafter Nachteile (Nano-Überwachungstechnologie!).

Im Jahr 2006 führte Daniel Kahan, Professor an der Yale Law School, zusammen mit einigen Kollegen eine Studie über die öffentliche Wahrnehmung der Nanotechnologie durch. Wie schon andere Umfragen zuvor stellten sie fest, dass die meisten Menschen wenig bis gar nichts über diesen Bereich wussten. Sie fanden auch heraus, dass Unwissenheit die Menschen nicht davon abhält, sich darüber zu äußern, ob die Risiken der Nanotechnologie ihre Vorteile überwiegen.

Als Kahan die uninformierten Befragten befragte, fielen ihre Meinungen sehr unterschiedlich aus. Als er jedoch einer anderen Gruppe von Befragten eine sehr kurze, sorgfältig ausgewogene Beschreibung der Verheißungen und Gefahren der Nanotechnologie gab, wurde die bemerkenswerte Anziehungskraft von tief verwurzelten, sakrosankten Überzeugungen deutlich. Auf der Grundlage von nur zwei Absätzen mit spärlichen (wenn auch zutreffenden) Informationen spalteten sich die Ansichten der Befragten zur Nanotechnologie deutlich - und stimmten mit ihren allgemeinen Weltanschauungen überein. Hierarchiker/Individualisten sahen die Nanotechnologie eher positiv. Egalitaristen/Kollektivisten vertraten den gegenteiligen Standpunkt und beharrten darauf, dass die Nanotechnologie mehr Schaden als Nutzen bringen kann.

Warum ist das so? Wegen der zugrunde liegenden Überzeugungen. Hierarchisten, die Autoritätspersonen wohlwollend gegenüberstehen, respektieren möglicherweise die führenden Vertreter von Industrie und Wissenschaft, die die unbewiesenen Versprechen der Nanotechnologie anpreisen. Egalitaristen hingegen könnten befürchten, dass die neue Technologie einen Vorteil darstellt, der nur einigen wenigen Menschen zugute kommt. Und Kollektivisten könnten sich Sorgen machen, dass die Nanotechnologieunternehmen die Auswirkungen ihrer Branche auf die Umwelt und die öffentliche Gesundheit nicht ausreichend berücksichtigen. Kahans Schlussfolgerung: Wenn zwei Absätze Text ausreichen, um die Menschen auf einen Gleitpfad zur Polarisierung zu schicken, dann wird die bloße Bereitstellung von mehr Informationen in der Öffentlichkeit wahrscheinlich nicht dazu beitragen, dass sie zu einem gemeinsamen, neutralen Verständnis der Fakten gelangen; sie wird lediglich ihre voreingenommenen Ansichten verstärken.

Man könnte meinen, dass es schwer ist, sich eine Meinung über eine esoterische Technologie zu bilden. Um zu wissen, ob die Nanotechnologie ein Segen für die Menschheit oder ein Schritt in Richtung Weltuntergang ist, müsste man über Materialwissenschaften, Ingenieurwesen, Industriestrukturen, rechtliche Fragen, organische Chemie, Oberflächenwissenschaften, Halbleiterphysik, Mikrofabrikation und Molekularbiologie Bescheid wissen. Jeden Tag verlassen sich die Menschen jedoch auf das kognitive Durcheinander in ihren Köpfen - sei es ein ideologischer Reflex, eine falsch angewandte Theorie oder eine ihnen in die Wiege gelegte Intuition -, um technische, politische und soziale Fragen zu beantworten, in denen sie wenig oder gar kein direktes Fachwissen haben. Wir sind nie allzu weit von Tonya und den Hardings entfernt.

DURCH DAS DURCHEINANDER SEHEN

Leider neigen wir alle dazu, dass politische Maßnahmen und Entscheidungen, die auf Unwissenheit beruhen, früher oder später nach hinten losgehen. Wie können also politische Entscheidungsträger, Lehrer und wir alle das gefälschte Wissen - unser eigenes und das unserer Nachbarn - durchschauen, das uns daran hindert, wirklich fundierte Urteile zu fällen?

Die Art und Weise, wie wir uns traditionell Unwissenheit vorstellen - als einen Mangel an Wissen - verleitet uns dazu, Bildung als natürliches Gegenmittel zu betrachten. Aber Bildung, selbst wenn sie geschickt eingesetzt wird, kann ein trügerisches Vertrauen erzeugen. Hier ist ein besonders erschreckendes Beispiel: Fahrschulkurse, insbesondere solche, die auf die Bewältigung von Notfallmanövern abzielen, erhöhen die Unfallzahlen eher, als dass sie sie senken. Das liegt daran, dass die Teilnehmer, wenn sie z. B. den Umgang mit Schnee und Eis trainieren, den dauerhaften Eindruck gewinnen, sie seien permanente Experten auf diesem Gebiet. Tatsächlich lassen ihre Fähigkeiten nach dem Kurs meist schnell nach. Und so haben sie Monate oder sogar Jahrzehnte später zwar Selbstvertrauen, aber wenig Kompetenz übrig, wenn die Räder zu drehen beginnen.

In solchen Fällen könnte der aufgeklärteste Ansatz, wie ihn der schwedische Forscher Nils Petter Gregersen vorschlägt, darin bestehen, solche Fähigkeiten überhaupt nicht zu vermitteln. Anstatt den Fahrern beizubringen, wie man mit Glatteis umgeht, schlägt Gregersen vor, dass der Unterricht vielleicht nur die damit verbundenen Gefahren vermitteln sollte - unerfahrene Fahrschüler sollten davon abgeschreckt werden, überhaupt bei winterlichen Bedingungen zu fahren, und es dabei belassen.

Aber natürlich ist es selten eine Option, Menschen vor ihrer eigenen Unwissenheit zu schützen, indem man sie vor den Risiken des Lebens bewahrt. Die Menschen tatsächlich dazu zu bringen, ihren Irrglauben aufzugeben, ist eine viel schwierigere und wichtigere Aufgabe. Glücklicherweise entwickelt sich unter der Leitung von Wissenschaftlern wie Stephan Lewandowsky von der University of Bristol und Ullrich Ecker von der University of Western Australia eine Wissenschaft, die dabei helfen könnte.

Im Klassenzimmer sind einige der besten Techniken zur Entschärfung von Missverständnissen im Wesentlichen Variationen der sokratischen Methode. Um die häufigsten Irrglauben zu beseitigen, kann der Lehrer eine Unterrichtsstunde mit ihnen eröffnen - und dann den Schülern die Erklärungslücken zeigen, die diese Irrglauben hinterlassen, oder die unplausiblen Schlussfolgerungen, zu denen sie führen. Eine Lehrkraft könnte beispielsweise eine Diskussion über die Evolution damit beginnen, dass sie den zielgerichteten evolutionären Irrtum darlegt und die Klasse dazu auffordert, ihn zu hinterfragen. (Woher wissen Arten auf magische Weise, welche Vorteile sie entwickeln sollten, um sie ihren Nachkommen zukommen zu lassen? Wie schaffen sie es, sich zu entscheiden, als Gruppe zu arbeiten?) Eine solche Herangehensweise kann die richtige Theorie einprägsamer machen, wenn sie enthüllt wird, und kann zu allgemeinen Verbesserungen der analytischen Fähigkeiten führen.

Dann gibt es natürlich noch das Problem der grassierenden Fehlinformationen an Orten, die im Gegensatz zu Klassenzimmern schwer zu kontrollieren sind, wie das Internet und die Nachrichtenmedien. In diesen Wildwest-Gebieten ist es am besten, gängige Irrglauben überhaupt nicht zu wiederholen. Wenn man den Leuten sagt, dass Barack Obama kein Muslim ist, kann man die Meinung vieler Menschen nicht ändern, weil sie sich häufig an alles erinnern, was gesagt wurde - mit Ausnahme des entscheidenden Zusatzes "nicht". Um einen Irrglauben erfolgreich auszurotten, muss man nicht nur den Irrglauben beseitigen, sondern auch die zurückgelassene Lücke füllen ("Obama wurde 1988 als Mitglied der United Church of Christ getauft"). Wenn es unbedingt notwendig ist, den Irrglauben zu wiederholen, haben Forscher herausgefunden, dass es hilft, klare und wiederholte Warnungen zu geben, dass der Irrglaube falsch ist. Ich wiederhole: falsch.

Die am schwierigsten auszuräumenden Irrglauben sind natürlich diejenigen, die sakrosankte Überzeugungen widerspiegeln. Und die Wahrheit ist, dass diese Vorstellungen oft nicht geändert werden können. Wenn eine unantastbare Überzeugung in Frage gestellt wird, wird das gesamte Selbst in Frage gestellt, und die Menschen werden die Ansichten, die ihnen lieb und teuer sind, aktiv verteidigen. Diese Art der Bedrohung einer Kernüberzeugung kann jedoch manchmal dadurch gemildert werden, dass man den Menschen die Möglichkeit gibt, ihre Identität anderweitig zu festigen. Forscher haben herausgefunden, dass die Aufforderung an die Menschen, Aspekte von sich selbst zu beschreiben, die sie stolz machen, oder über Werte zu berichten, die ihnen wichtig sind, eine aufkommende Bedrohung weniger bedrohlich erscheinen lassen kann.

In einer von Geoffrey Cohen, David Sherman und anderen Kollegen durchgeführten Studie waren beispielsweise selbsternannte amerikanische Patrioten empfänglicher für die Behauptungen eines Berichts, der sich kritisch über die US-Außenpolitik äußerte, wenn sie zuvor einen Aufsatz über einen wichtigen Aspekt ihrer Person, wie ihre Kreativität, ihren Sinn für Humor oder ihre Familie, verfasst und erklärt hatten, warum dieser Aspekt für sie besonders bedeutsam war. In einer zweiten Studie, in der Studenten, die Abtreibungsgegner sind, darüber verhandelten, wie die Abtreibungspolitik auf Bundesebene aussehen sollte, machten die Teilnehmer mehr Zugeständnisse an Abtreibungsbeschränkungen, nachdem sie ähnliche selbstbejahende Aufsätze geschrieben hatten.

Manchmal haben Forscher auch herausgefunden, dass sakrosankte Überzeugungen selbst genutzt werden können, um eine Person davon zu überzeugen, eine Reihe von Fakten mit weniger Vorurteilen zu überdenken. So neigen Konservative beispielsweise nicht so sehr wie Liberale dazu, Maßnahmen zum Schutz der Umwelt zu befürworten. Aber Konservative interessieren sich für Themen, bei denen es um "Reinheit" in Gedanken, Taten und Realität geht. Die Darstellung des Umweltschutzes als Chance, die Reinheit der Erde zu bewahren, führt dazu, dass Konservative diese Maßnahmen viel stärker befürworten, wie Untersuchungen von Matthew Feinberg und Robb Willer von der Stanford University zeigen. In ähnlicher Weise können Liberale davon überzeugt werden, die Militärausgaben zu erhöhen, wenn eine solche Politik von vornherein mit progressiven Werten wie Fairness und Gerechtigkeit verknüpft wird - zum Beispiel mit dem Hinweis, dass das Militär Rekruten einen Ausweg aus der Armut bietet oder dass militärische Beförderungsstandards für alle gleichermaßen gelten.

Aber hier liegt die eigentliche Herausforderung: Wie können wir lernen, unsere eigene Unwissenheit und unseren Irrglauben zu erkennen? Stellen Sie sich zunächst vor, dass Sie Teil einer kleinen Gruppe sind, die eine Entscheidung über eine wichtige Angelegenheit treffen muss. Verhaltenswissenschaftler empfehlen oft, dass kleine Gruppen jemanden ernennen, der als Anwalt des Teufels fungiert - eine Person, deren Aufgabe es ist, die Logik der Gruppe zu hinterfragen und zu kritisieren. Dieser Ansatz kann zwar die Gruppendiskussionen in die Länge ziehen, die Gruppe irritieren und unangenehm sein, aber die Entscheidungen, zu denen die Gruppe schließlich gelangt, sind in der Regel genauer und fundierter als sie es sonst wären.

Für den Einzelnen besteht der Trick darin, selbst als Anwalt des Teufels aufzutreten: Überlegen Sie, wie Ihre bevorzugten Schlussfolgerungen fehlgeleitet sein könnten; fragen Sie sich, wie Sie sich irren könnten oder wie sich die Dinge anders entwickeln könnten, als Sie es erwarten. Es ist hilfreich, das zu praktizieren, was der Psychologe Charles Lord "das Gegenteil in Betracht ziehen" nennt. Dazu stelle ich mir oft eine Zukunft vor, in der ich mich bei einer Entscheidung geirrt habe, und überlege dann, welcher Weg am wahrscheinlichsten zu meinem Scheitern geführt hätte. Und zu guter Letzt: Holen Sie sich Rat. Andere Menschen mögen ihre eigenen Irrglauben haben, aber ein Gespräch kann oft schon ausreichen, um einen ernsthaften Menschen von seinen schlimmsten Irrtümern zu befreien.

STAATSBÜRGERKUNDE FÜR AUFGEKLÄRTE DUMMKÖPFE

In einer Ausgabe von "Lie Witness News" im Januar dieses Jahres schwenkten die Kameras von Jimmy Kimmel auf die Straßen von Los Angeles - einen Tag, bevor Präsident Barack Obama seine jährliche Rede zur Lage der Nation halten sollte. Die Befragten wurden über John Boehners Nickerchen während der Rede und den Moment am Ende, als Obama einen Herzinfarkt vortäuschte, befragt. Die Bewertungen der fiktiven Rede reichten von "großartig" über "kraftvoll" bis hin zu "ganz gut". Wie üblich hatten die Produzenten keine Probleme, Leute zu finden, die bereit waren, über Ereignisse zu sprechen, von denen sie nichts wissen konnten.

Amerikanische Komiker wie Kimmel und Jay Leno haben eine lange Tradition darin, sich über die Unwissenheit ihrer Landsleute lustig zu machen, und amerikanische Schurken haben eine lange Tradition darin, sie zu beklagen. Alle paar Jahre, zumindest im letzten Jahrhundert, haben verschiedene Gruppen ernsthaft gesinnter Bürger Studien zur staatsbürgerlichen Bildung durchgeführt - sie befragten Mitglieder der Öffentlichkeit über die Geschichte und die Regierungsführung der Nation - und die Ergebnisse als Anlass zu großer Besorgnis über den kulturellen Niedergang und Verfall genommen. Nachdem eine Umfrage unter 7.000 Studienanfängern ergeben hatte, dass nur sechs Prozent die ursprünglichen 13 Kolonien identifizieren konnten (wobei einige glaubten, Abraham Lincoln, "unser erster Präsident", habe "die Sklaven ausgemergelt"), beklagte die "New York Times" 1943 die "erschreckend unwissende" Jugend der Nation. Im Jahr 2002, nachdem ein landesweiter Test von Viert-, Acht- und Zwölftklässlern zu ähnlichen Ergebnissen geführt hatte, erklärte der Weekly Standard Amerikas Schüler für "dumm wie Steine".

Weil es so einfach ist, die Idiotie anderer zu beurteilen, ist es vielleicht verlockend zu denken, dass dies nicht auf einen selbst zutrifft. Aber das Problem der unerkannten Unwissenheit ist eines, das uns alle betrifft.

Im Jahr 2008 befragte das Intercollegiate Studies Institute 2 508 Amerikaner und fand heraus, dass 20 Prozent von ihnen glauben, dass das Wahlmännerkollegium "diejenigen ausbildet, die ein höheres politisches Amt anstreben" oder "eingeführt wurde, um die ersten im Fernsehen übertragenen Präsidentschaftsdebatten zu überwachen". Erneut wurde Alarm geschlagen über den Niedergang der staatsbürgerlichen Bildung. Ironischerweise sind, wie der Stanford-Historiker Sam Wineburg geschrieben hat, Menschen, die Amerikas zunehmende Unkenntnis der eigenen Geschichte beklagen, selbst oft blind dafür, dass viele vor ihnen genau das Gleiche beklagt haben; ein Blick zurück lässt nicht auf einen Rückgang der amerikanischen Größe schließen, sondern auf ein ziemlich konstantes Niveau an Ungeschicklichkeit im Umgang mit den Fakten.

Der Impuls, sich über all diese verpatzten Antworten zu ärgern, hat einen gewissen Sinn, wenn man bedenkt, dass es sich um Staatsbürgerkunde handelt. "Die Fragen, die so viele Schüler verblüfften", beklagte Bildungsminister Rod Paige nach einem Test im Jahr 2001, "betreffen die grundlegendsten Konzepte unserer Demokratie, unseres Wachstums als Nation und unserer Rolle in der Welt." Eine implizite, schambesetzte Frage scheint zu sein: Was würden wohl die Gründerväter von diesen Nachkommen halten?

Aber ich glaube, wir wissen bereits, was die Gründerväter denken würden. Als gute Bürger der Aufklärung legten sie mindestens ebenso viel Wert darauf, die Grenzen des eigenen Wissens zu erkennen, wie darauf, ein Bündel von Fakten zu behalten. Thomas Jefferson, der die Qualität des politischen Journalismus seiner Zeit beklagte, stellte einmal fest, dass jemand, der Zeitungen meidet, besser informiert ist als ein täglicher Leser, da jemand, der nichts weiß, der Wahrheit näher ist als jemand, dessen Geist mit Unwahrheiten und Irrtümern gefüllt ist. Benjamin Franklin schrieb, dass "ein gelehrter Dummkopf ein größerer Dummkopf ist als ein unwissender". Ein anderes Zitat, das Franklin manchmal zugeschrieben wird, besagt, dass "die Türschwelle zum Tempel der Weisheit das Wissen um unsere eigene Unwissenheit ist".

Die eingebauten Eigenschaften unseres Gehirns und die Lebenserfahrungen, die wir sammeln, füllen unsere Köpfe in der Tat mit unermesslichem Wissen; was sie nicht vermitteln, ist Einsicht in die Dimensionen unserer Unwissenheit. Weisheit besteht also weniger aus Fakten und Formeln als vielmehr aus der Fähigkeit zu erkennen, wann eine Grenze erreicht ist. Durch all unser kognitives Durcheinander zu stolpern, nur um ein wahres "Ich weiß nicht" zu erkennen, ist vielleicht nicht so sehr ein Versagen als vielmehr ein beneidenswerter Erfolg, ein entscheidender Wegweiser, der uns zeigt, dass wir auf dem richtigen Weg zur Wahrheit sind.